Компанія Mistral AI офіційно представила Mistral Small 4 — революційну гібридну модель на 119 мільярдів параметрів, яка встановлює новий стандарт для відкритого програмного забезпечення. Новинка об’єднує в собі можливості для чату, глибокого логічного мислення та складного програмування, пропонуючи розробникам безпрецедентну гнучкість під ліцензією Apache 2.0.

Що сталося

Французький стартап Mistral AI оголосив про випуск Mistral Small 4 (версія v26.03), яка стала значним кроком вперед у розвитку лінійки “Small”. Головна новина полягає в тому, що розробникам вдалося об’єднати три раніше розрізнені сімейства моделей в одну потужну систему. Тепер Mistral Small 4 інтегрує в собі можливості інструктивної моделі (Instruct), логічного мислення (раніше відомого як Magistral) та спеціалізованого інструменту для кодингу (Devstral).

Цей реліз також ознаменував вступ Mistral AI до коаліції NVIDIA Nemotron Coalition, що підкреслює прагнення компанії до розвитку відкритих і доступних фронтирних моделей. Нова модель вже доступна на платформі Mistral La Plateforme, Hugging Face, а також підтримується такими популярними інструментами, як vLLM, llama.cpp та SGLang.

Як це працює

В основі Mistral Small 4 лежить вдосконалена архітектура Mixture-of-Experts (MoE) з неймовірною кількістю експертів — 128 модулів. Незважаючи на загальний обсяг у 119 мільярдів параметрів, модель залишається надзвичайно швидкою та ефективною, оскільки під час кожного запиту активуються лише 4 експерти (приблизно 6–8 мільярдів активних параметрів).

Ключові технічні характеристики моделі включають:

- Мультимодальність: Модель нативно підтримує обробку як текстових даних, так і зображень.

- Величезне вікно контексту: Підтримка до 256 000 токенів дозволяє аналізувати цілі бібліотеки коду або об’ємні технічні документи за один раз.

- Динамічне керування міркуваннями: Впроваджено новий параметр

reasoning_effort, який дозволяє користувачеві обирати між миттєвими відповідями для чату (режимnone) та глибоким покроковим аналізом складних завдань (режимhigh). - Економічна ефективність: Завдяки оптимізації, Mistral Small 4 демонструє на 40% нижчу затримку (latency) та втричі вищу пропускну здатність порівняно зі своєю попередницею, моделлю Small 3.

Чому це важливо

Випуск Mistral Small 4 змінює правила гри для бізнесу та розробників. По-перше, вона вирішує проблему “зоопарку моделей”. Замість того, щоб перемикатися між окремими нейромережами для написання коду, аналізу зображень та загальних запитів, користувачі отримують універсальний інструмент “все в одному”. Це спрощує архітектуру AI-додатків та зменшує витрати на інфраструктуру.

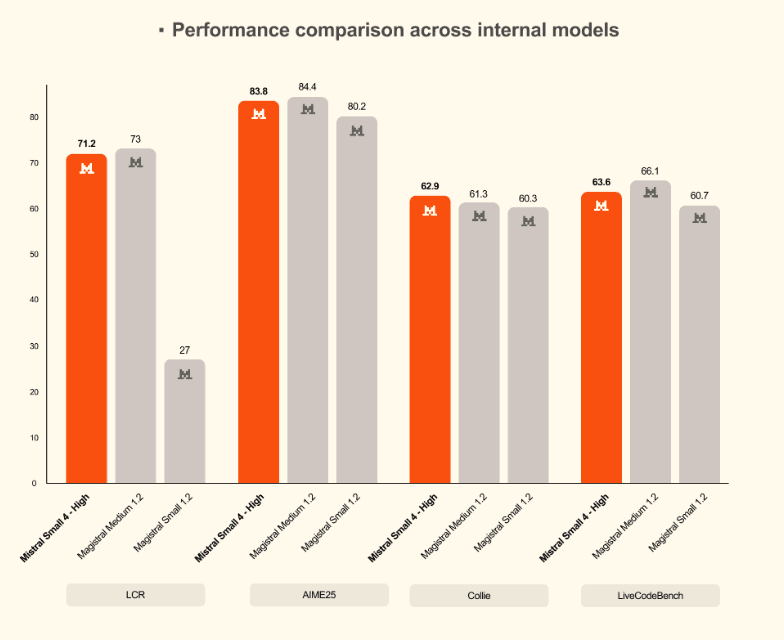

По-друге, продуктивність Mistral Small 4 вражає: у тестах LiveCodeBench та AIME 2025 модель не лише наздоганяє, а й подекуди випереджає пропрієтарні гіганти рівня GPT-OSS 120B. При цьому вона генерує значно лаконічніші та точніші відповіді, що безпосередньо впливає на зниження вартості токенів у комерційному використанні.

Відкрита ліцензія Apache 2.0 дозволяє компаніям вільно розгортати модель на власних серверах, забезпечуючи повну конфіденційність даних. Це критично важливо для банківського сектора, медицини та державних установ, де використання хмарних закритих систем обмежене регуляціями.

Висновок

Mistral Small 4 — це не просто чергове оновлення, а маніфест того, як відкриті моделі можуть конкурувати з закритими екосистемами. Поєднуючи в собі потужність 119B параметрів із легкістю експлуатації MoE-архітектури, Mistral AI надала світу інструмент, здатний до складних інтелектуальних міркувань та професійного програмування в рамках однієї мультимодальної системи.