У серпні 2025 року китайський стартап DeepSeek офіційно представив DeepSeek-V3.1 — версію, яка робить модель більш ефективною, орієнтованою на агентські сценарії й доступною для інтеграторів.

Основні нововведення DeepSeek-V3.1

- Гібридний режим інференсу (“Think” та “Non-Think”) — перемикання між режимами через кнопку «DeepThink» в чаті чи API.

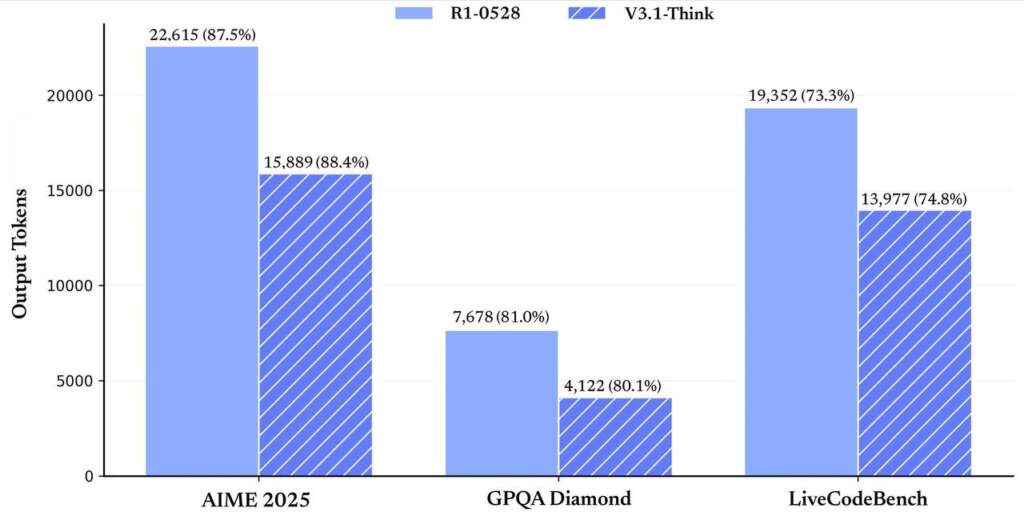

- Прискорене міркування та економія токенів — Think-режим швидший за R1-0528.

- Агентські можливості та Tool Use — у Terminal bench у 6 разів кращий результат.

- SWE-bench — 66% (вище за gpt-oss із 62%).

- Контекст — до 128К токенів.

Технічна архітектура та апаратні рішення

DeepSeek-V3.1 побудовано на MoE-архітектурі з Multi-head Latent Attention та FP8-форматом для економії ресурсів. В основі — модель DeepSeek-V3.1-Base з оновленим токенізатором і чат-шаблонами.

Ціни та API

З 6 вересня 2025 року діють тарифи: $0.56 / $1.68 за млн токенів. Попередні ціни були вищі — $0.55 / $2.19 за млн токенів. Нічні знижки скасовуються.

Порівняльна таблиця

| Характеристика | DeepSeek-V3.1 | GPT-OSS |

|---|---|---|

| Режими інференсу | Think / Non-Think | Один режим |

| Контекст | 128К токенів | 131К токенів |

| SWE-bench | 66% | 62% |

| Terminal bench | ×6 кращий за R1-0528 | — |

| Ціна | $0.56–$1.68 / млн токенів | ~$0.10 / млн токенів |

| Архітектура | MoE, MLA, FP8 | Різні |

DeepSeek-V3.1 поєднує швидкість міркування, потужні агентні можливості, великий контекст і доступність. Це робить його серйозним конкурентом GPT-OSS та інших сучасних моделей.

🔗 Джерела: Reuters, HuggingFace, DeepSeek Docs